2019年中國供應鏈管理產業競爭格局全局觀

隨著全球貿易格局的演變和數字化轉型的加速,供應鏈管理產業在中國經濟中的地位日益凸顯。2019年,中國供應鏈管理產業呈現出多元化、智能化和集中化的競爭格局。本文基于市場份額、企業經營對比及未來競爭前景,全面剖析該行業的現狀與發展趨勢。

一、市場份額分布

2019年,中國供應鏈管理產業市場規模持續擴大,達到約3.5萬億元人民幣,年增長率保持在10%以上。市場份額主要由三類企業主導:一是傳統物流巨頭,如順豐控股、中通快遞等,憑借其網絡優勢占據約40%的市場份額;二是電商平臺衍生的供應鏈服務商,如阿里巴巴的菜鳥網絡和京東物流,分別占據15%和12%的市場份額;三是專業第三方供應鏈管理公司,如中外運、怡亞通等,合計占約20%的市場份額。剩余份額由小型區域企業及新興科技公司瓜分。整體來看,市場集中度較高,前五名企業合計市場份額超過60%,反映出行業整合趨勢明顯。

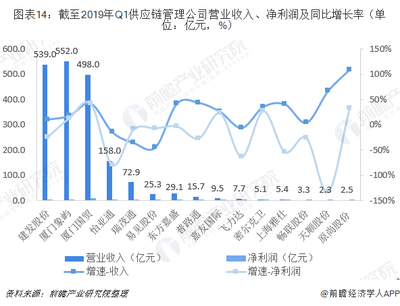

二、企業經營對比

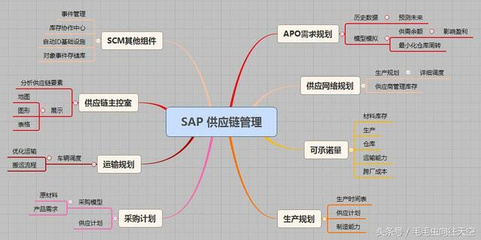

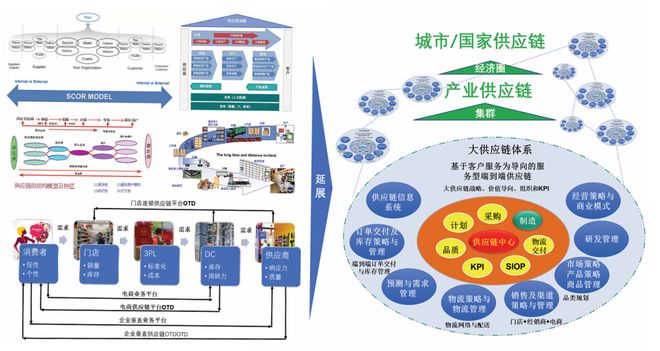

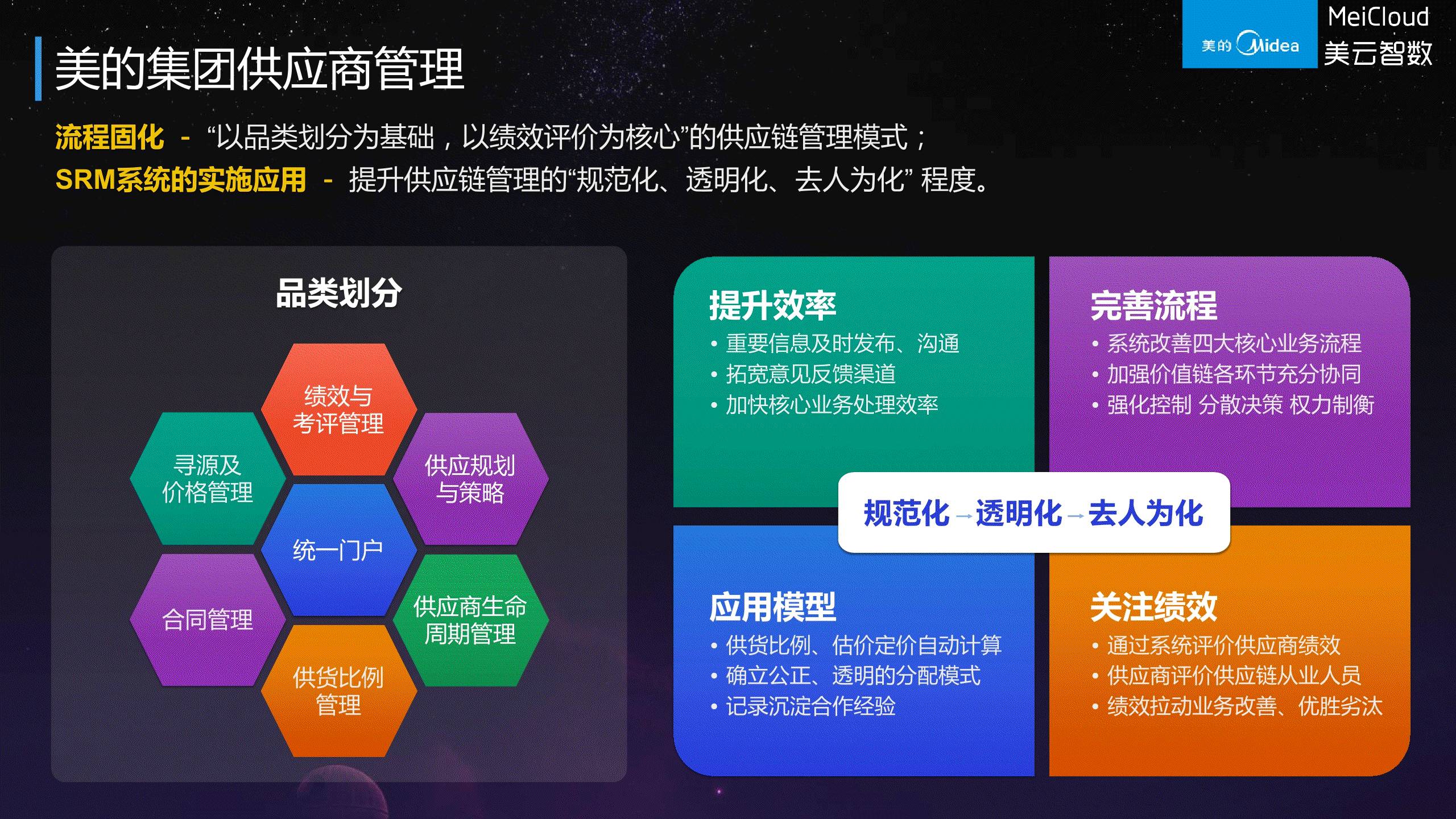

從企業經營層面分析,2019年主要企業在供應鏈管理領域展現出差異化競爭優勢。順豐控股以高效的倉儲和配送網絡為核心,營業收入超千億元,凈利潤率約5%;菜鳥網絡依托阿里巴巴的電商生態,通過大數據和AI技術優化供應鏈,實現快速擴張,但受高投入影響,短期內盈利能力較弱。京東物流則以自建物流體系為特色,強調全鏈路服務,2019年收入增長超30%,但面臨成本壓力。相比之下,怡亞通等第三方企業專注于供應鏈整合服務,客戶覆蓋快消、醫療等多個行業,利潤率穩定在4-6%區間。經營效率上,領先企業普遍采用物聯網、區塊鏈等技術提升透明度,而中小企業則因資金限制,數字化進程較慢。

三、競爭前景展望

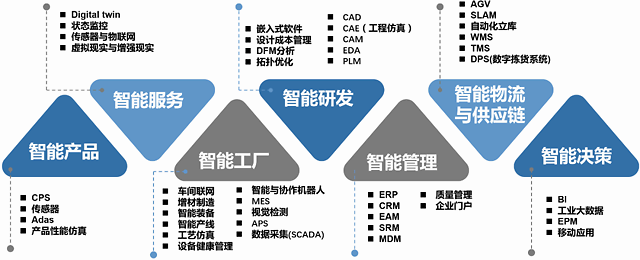

中國供應鏈管理產業的競爭將更加激烈。一方面,政策支持如“一帶一路”倡議和數字經濟發展規劃,為行業提供廣闊空間;另一方面,技術革新如5G、人工智能將驅動供應鏈向智能化、柔性化轉型。預計到2025年,市場份額將進一步向頭部企業集中,但新興玩家如科技初創公司可能通過創新模式切入細分市場。競爭焦點將從成本控制轉向全鏈路效率和服務質量,企業需加強合作與整合,以應對全球供應鏈不確定性的挑戰。總體而言,產業前景樂觀,但企業需持續創新以保持競爭力。

2019年中國供應鏈管理產業在格局穩定中孕育變革,企業應把握技術機遇,優化資源配置,以實現可持續發展。

如若轉載,請注明出處:http://m.twfooddoctor.cn/product/28.html

更新時間:2026-04-15 14:49:50